2026년 AI, 이제 대답하는 게 아니라 움직입니다

지금 여행 앱을 켜서 "다음 달 제주도 여행 잡아줘"라고 말한다면 어떻게 될까요. AI가 항공권 검색, 숙소 비교, 결제까지 스스로 처리하는 일이 2026년에는 실험적인 데모가 아니라 실제 서비스로 자리잡을 것으로 보입니다.

MIT Technology Review는 2026년의 AI를 '지시에 반응하는 챗봇'이 아닌 `에이전트형 AI`로 정의합니다. 목표를 받으면 스스로 단계를 나누고 필요한 도구를 골라 실행하는 방식입니다. 우리가 AI를 '질문하는 도구'로 써왔다면, 이제는 '일을 맡기는 대상'으로 보게 될 전환점입니다.

그 순간부터 편리함만이 아니라 책임의 기준, 실수의 비용, 감독의 역할도 같이 달라집니다.

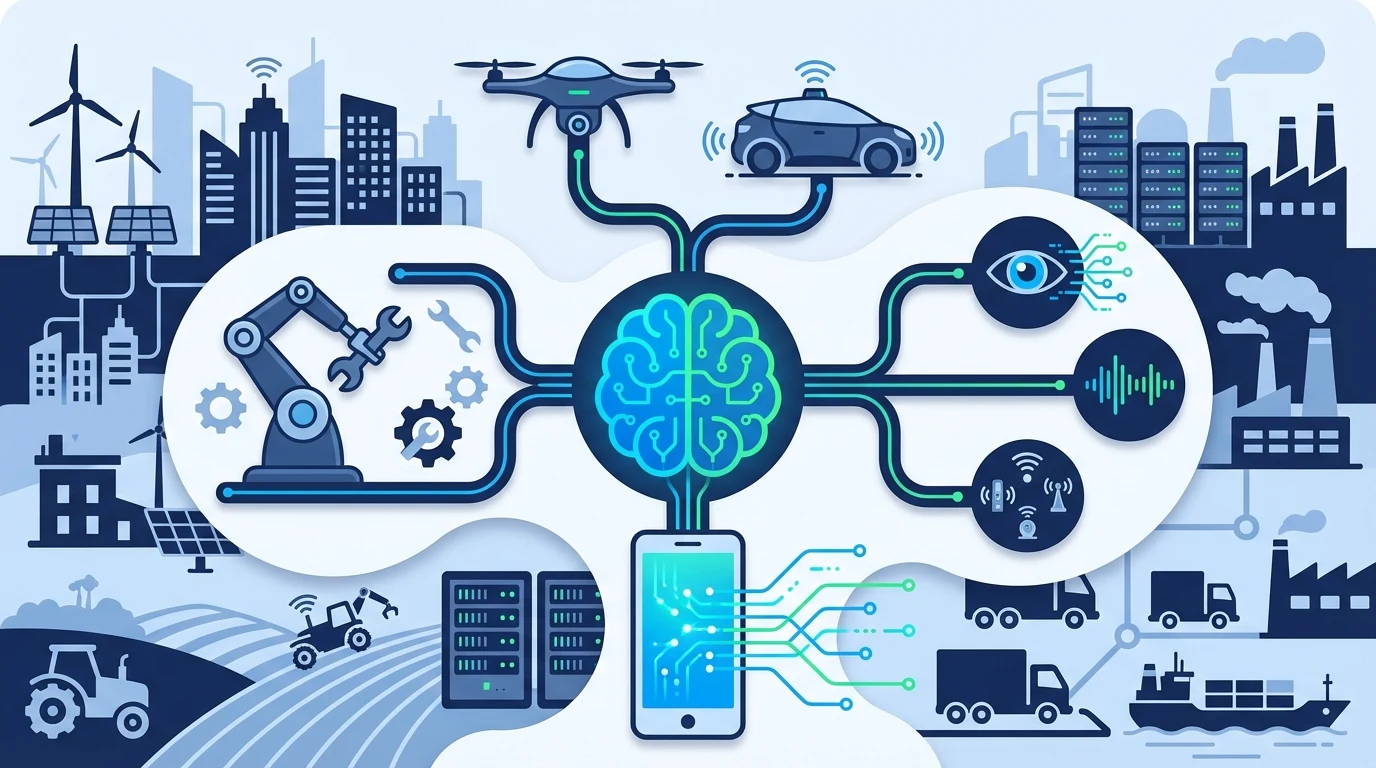

화면 밖으로 나온 AI — 산업 현장에서 무슨 일이 벌어지나

SK텔레콤이 짚은 2026년 핵심 흐름 중 하나는 `피지컬 AI`입니다. 로봇에 AI 두뇌를 결합해 물류, 제조, 건설, 농업 같은 현장에서 반복적이거나 위험한 작업을 사람 없이 처리하는 방향이 본격화된다는 이야기입니다.

감이 안 잡힌다면 이렇게 보면 됩니다. 최근 몇 년 새 산업용 센서 가격이 낮아지고, AI는 시뮬레이션으로 수백만 번의 작업을 학습하며, 생성형 AI가 예외 판단 능력까지 보완하고 있습니다. 이 세 가지가 맞물리면서 "현장에서 쓸 수 있는 수준"에 점점 가까워지고 있습니다.

현장 관리자 입장에서는 단순 작업이 자동화되는 대신, 예외 상황 대응·품질 검수·안전 책임 같은 역할이 더 무거워지는 구조입니다.

AI가 눈과 귀를 갖게 되면, 인터페이스 자체가 바뀝니다

BJC저널은 2026년에 멀티모달 AI가 사실상 표준이 될 것으로 봤습니다. 텍스트만 다루는 게 아니라 음성, 이미지, 영상, 센서 데이터를 동시에 처리하는 모델이 보편화되고, 대화 방식도 타이핑 중심에서 말하고 보여주는 방식으로 이동한다는 전망입니다.

LG AI연구원이 MWC 2026에서 공개한 `엑사원(EXAONE) 4.5`도 이 흐름의 연장선입니다. 언어와 시각 지능을 결합해 맥락을 더 넓게 읽는 능력이 경쟁력의 핵심으로 부상하고 있습니다. 사용자 입장에서는 AI를 쓰는 진입 장벽이 낮아지는 것처럼 보이지만, 동시에 AI가 수집하고 처리하는 정보의 범위도 훨씬 넓어진다는 의미이기도 합니다.

일자리 불안, 솔직히 어느 부분이 현실적인가

AI 뉴스를 볼 때 일자리 걱정이 먼저 드는 건 자연스러운 반응입니다. 저숙련 반복 업무를 중심으로 자동화 압력이 커지고 사회적 불평등이 심화될 수 있다는 점은 분명한 위험으로 꼽힙니다.

다만 실제로 벌어지는 일은 "모두 대체"보다는 업무가 분해되고 재조합되는 쪽에 가깝습니다. 고객 응대, 문서 정리, 기본 분석, 예약·결제 프로세스는 자동화 속도가 빨라지지만, 예외 판단·책임 소재 정리·신뢰 관리는 오히려 사람 손이 더 필요해지는 구조입니다.

기업 입장에서도 중요한 건 도입 자체보다 선 긋기입니다. 어떤 업무를 AI에 넘기고 어디에 사람을 남길지 제대로 설계하지 않으면 비용은 올라가고 성과는 늦어집니다. AI 투자 규모는 급증하고 있지만 실제 비즈니스 성과까지는 시간이 걸린다는 'AI 버블' 우려가 정확히 여기서 나옵니다.

규제가 기술을 따라잡는 해 — 2026년에 달라지는 것들

2026년은 유럽연합 AI 법이 전면 시행되는 해입니다. 한국도 `AI 기본법`을 통해 기업의 책임을 더 명확히 요구하는 방향으로 가고 있고, LG AI연구원이 안전과 신뢰를 전면에 내세운 윤리 책무성 보고서를 낸 것도 같은 흐름입니다.

AI가 사회 인프라의 일부가 될수록 편향·허위 정보·개인정보 침해는 기술적 부작용이 아니라 실제 운영 리스크가 됩니다. 에이전트형 AI처럼 스스로 판단하고 실행하는 범위가 넓어질수록, 통제 실패의 비용도 그만큼 커집니다.

AI 전쟁의 속사정 — 전력, 칩, 그리고 주권

딜로이트가 분석한 2026년 AI 컴퓨팅 구도를 보면, 전체 파워의 약 3분의 2가 새 모델을 학습하는 데가 아니라 이미 만든 모델을 대규모로 실행하는 `추론`에 쓰일 것으로 전망됩니다. 좋은 모델을 만드는 것만큼, 그걸 실시간으로 돌릴 수 있는 인프라가 핵심이라는 뜻입니다. 수만에서 수십만 개의 GPU가 상시 가동되는 초대형 데이터센터가 필요해지는 이유이기도 합니다.

여기에 국가별 AI 주권 경쟁이 더해집니다. 미국과 중국 외 지역이 자체 AI 컴퓨팅 인프라에 1천억 달러 이상을 투자할 가능성이 높다는 전망이 나오는 가운데(딜로이트, BJC저널 인용), "남의 AI를 빌려 쓰기만 해서는 안 된다"는 판단이 각국 정부 수준에서 굳어지고 있습니다.

다만 이 경쟁에는 그늘도 있습니다. 기술 생태계가 쪼개지고, 에너지 소비와 과잉 인프라 투자 같은 부작용이 따릅니다. 누가 먼저 크냐보다 누가 지속 가능하게 운영하느냐가 장기 판단 기준이 됩니다.

지금 개인과 기업이 먼저 해야 할 것

이 변화는 개발자만의 문제가 아닙니다. 반복적인 사무 업무가 있는 직장인, 현장 관리자, AI 도입을 검토 중인 중소기업, 정보 신뢰성을 자주 판단해야 하는 마케터나 기획자 모두에게 직접 연결되는 이야기입니다.

개인이라면 자신의 일에서 반복적·규칙적인 작업을 먼저 파악하고, AI가 초안까지만 처리할 영역인지 실행까지 맡길 영역인지 구분하는 것부터 시작하면 됩니다. AI를 잘 쓰는 기술보다, 어디까지 맡기고 어디서 멈출지 판단하는 능력이 앞으로 더 중요한 역량이 됩니다.

기업이라면 세 가지를 먼저 점검해야 합니다. 자동화 후보 업무가 실제로 존재하는지, 결과를 검수하고 책임질 사람이 있는지, 개인정보·허위 정보·편향에 대응할 내부 기준이 있는지입니다. 이 세 가지 없이 도입만 서두르면 AI 버블의 피해를 고스란히 떠안을 수 있습니다.

마무리

2026년의 AI 변화는 초월적인 모델 하나가 갑자기 등장하는 게 아닙니다. 에이전트형 AI, 피지컬 AI, 멀티모달 AI, 그리고 이를 둘러싼 인프라와 규제가 동시에 현실로 밀려오는 흐름입니다.

그래서 진짜 질문도 단순합니다. "AI가 얼마나 대단해질까"가 아니라, "나는 어디까지 맡기고 무엇은 끝까지 내가 책임질 것인가"입니다. 그 기준을 먼저 세운 사람과 조직이 이 속도를 가장 잘 다루게 될 겁니다.